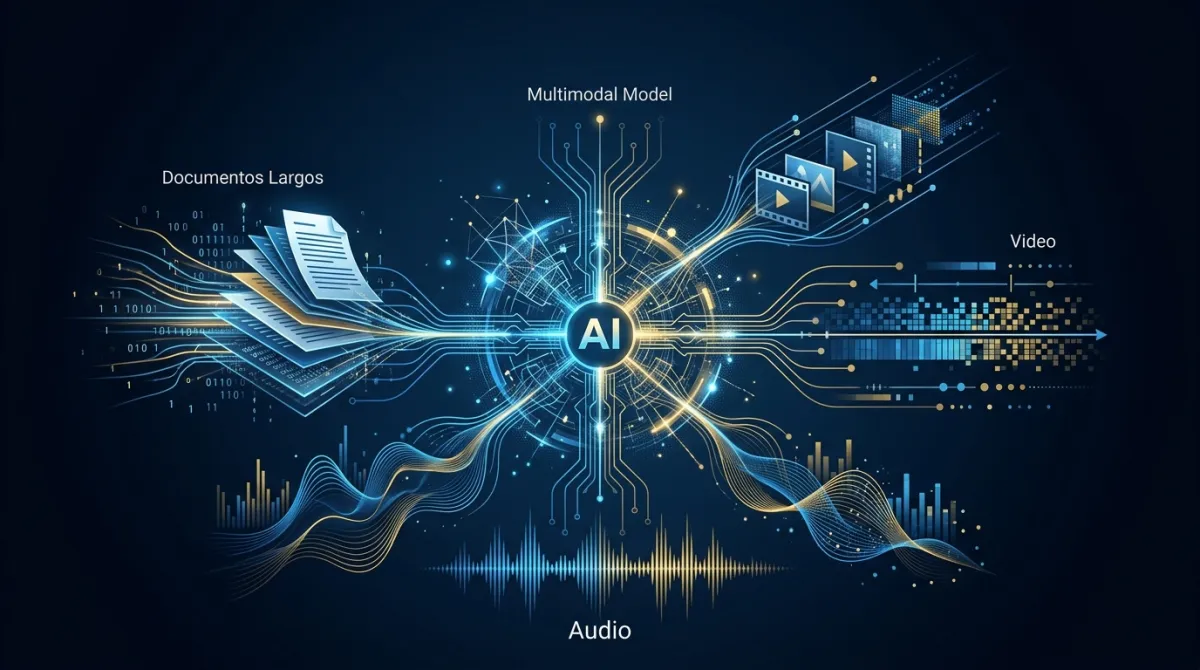

Nemotron 3 Nano Omni: modelo multimodal para documentos largos, audio y video

Nemotron 3 Nano Omni extiende la línea Nemotron hacia un modelo que integra texto, imagen, audio y video para análisis documental, reconocimiento de voz y entendimiento de largo alcance. Ofrece mejoras de precisión y eficiencia en tareas complejas y casos de uso agentivos.

Qué es Nemotron 3 Nano Omni

NVIDIA presentó Nemotron 3 Nano Omni como un modelo omni-modal diseñado para entender y razonar sobre documentos extensos, múltiples imágenes, audio largo y video, además de operar como asistente en entornos con interfaz gráfica. Se trata de una evolución de la familia Nemotron que incorpora visión, texto, audio y video en un único modelo con enfoque en contextos multimodales de gran longitud.

El equipo detrás del modelo destaca su buen desempeño en retos de inteligencia documental (por ejemplo MMlongbench-Doc y OCRBenchV2) y su competitividad en pruebas de video y audio como WorldSense, DailyOmni y VoiceBench. NVIDIA también publica checkpoints en formatos BF16, FP8 y NVFP4 en Hugging Face para quienes quieran probarlo o incorporarlo a flujos de trabajo.

Principales capacidades y casos de uso

Nemotron 3 Nano Omni fue pensado para cinco clases principales de carga de trabajo:

-

Análisis de documentos del mundo real: no se limita a OCR básico. Está orientado a documentos largos y complejos —contratos, artículos técnicos, manuales, formularios multi-página y paquetes de cumplimiento— donde el entendimiento requiere considerar el diseño, tablas, figuras, fórmulas y referencias cruzadas. Puede manejar documentos de más de 100 páginas.

-

Reconocimiento automático de voz (ASR): incorpora capacidades robustas de reconocimiento para transcripción de audio largo con múltiples hablantes y condiciones acústicas variables, permitiendo integrar esos textos a tareas de resumen, preguntas y respuestas o razonamiento multimodal.

-

Entendimiento de audio y video a largo plazo: útil para grabaciones de pantalla con narración, videos de capacitación, reuniones con diapositivas, demos de producto o archivos audiovisuales extensos. El modelo razona sobre la evidencia combinada de audio y visuales.

-

Uso agente en computadoras (agentic computer use): está entrenado para actuar en entornos GUI, interpretar capturas de pantalla, monitorear estados de interfaz y asistir en la selección de acciones o automatización de flujos de trabajo.

-

Razonamiento multimodal general: orientado a tareas que requieren síntesis de información en ventanas de contexto largas, integrando texto, imágenes, tablas y otras fuentes para resolver problemas en múltiples pasos y realizar cálculos o inferencias complejas.

Arquitectura y componentes clave

Nemotron 3 Nano Omni sigue un diseño unificado encoder-projector-decoder. La columna vertebral es Nemotron 3 Nano 30B-A3B, que actúa como el backbone de lenguaje. A este se conectan dos encoders especializados: el C-RADIOv4-H para visión y el Parakeet-TDT-0.6B-v2 para audio. Las conexiones entre encoders y el LLM se realizan mediante projectores ligeros.

En el núcleo del modelo hay una combinación híbrida de técnicas para manejar contextos largos y multimodales:

- Capas de estado selectivo tipo Mamba (23 capas) para procesamiento eficiente de contexto extenso.

- Capas Mixture-of-Experts (MoE) (23 capas) con 128 expertos y ruteo top-6, que permiten aumentar capacidad condicionalmente sin inflar el costo para todas las inferencias.

- Capas de grouped-query attention (6 capas) para mantener interacción global y expresividad.

Esta mezcla de modelos de estado, atención y MoE permite conservar capacidad de razonamiento mientras se mantiene eficiencia práctica en contextos multimodales muy largos.

En visión, Nemotron 3 Nano Omni introduces procesamiento de resolución dinámica para documentos densos, gráficos y pantallas (en lugar de la estrategia de tiling usada en versiones previas), con el objetivo de preservar detalles visuales finos sin generar un costo computacional excesivo. Además, integra nativamente el entendimiento de audio para flujos largos.

Entrenamiento y optimizaciones

La receta de entrenamiento combina varias etapas: alineación multimodal escalonada, extensión de contexto, optimización por preferencias y aprendizaje por refuerzo multimodal. Estas fases buscan no solo enseñar reconocimiento y alineación entre modalidades, sino también ajustar el comportamiento del modelo hacia interacciones más útiles y coherentes para tareas complejas.

NVIDIA reporta mejoras sustanciales en throughput y velocidad de razonamiento: hasta 9x mayor throughput y 2.9x más velocidad en razonamiento de un flujo único en casos multimodales, en comparación con alternativas de peso abierto.

Rendimiento en benchmarks y eficiencia

Nemotron 3 Nano Omni muestra resultados líderes en varios leaderboards. Entre los hitos publicados están:

- OCRBenchV2-En: 65.8 (frente a 61.2 de Nemotron Nano V2 VL).

- MMLongBench-Doc: 57.5 (vs 38.0) y superior a Qwen3-Omni que marca 49.5.

- CharXiv reasoning: 63.6 (vs 41.3), ligeramente por encima de Qwen3-Omni en 61.1.

- GUI ScreenSpot-Pro: 57.8 (vs 5.5) y cercano a Qwen3-Omni en 59.7.

- Video-MME: 72.2 (vs 63.0) y por encima de Qwen3-Omni en 70.5.

- WorldSense y DailyOmni (video+audio): 55.4 y 74.1 respectivamente, frente a 54.0 y 73.6 de Qwen3-Omni.

- VoiceBench de audio: 89.4 frente a 88.8 de Qwen3-Omni.

- En ASR cerrado HF Open ASR (donde menor es mejor) Nemotron 3 registra 5.95 frente a 6.55 de Qwen3-Omni.

En términos de eficiencia del sistema, Nemotron 3 Nano Omni alcanza mayores niveles: 7.4x más eficiencia para escenarios multi-documento y 9.2x para casos de video, medidos según el throughput total sostenido por usuario bajo un umbral de interactividad fijo.

Implicaciones para organizaciones en América Latina

Para empresas y organismos de la región, Nemotron 3 Nano Omni abre posibilidades prácticas: automatizar revisión de contratos largos, procesar archivos regulatorios y de cumplimiento, transcribir y analizar reuniones o capacitaciones, y construir asistentes que interactúen con interfaces gráficas para automatizar tareas. Su capacidad para operar sobre contextos extensos reduce la necesidad de fragmentar documentos o videos, lo que puede simplificar implementaciones y reducir latencia en flujos de trabajo.

Sin embargo, antes de desplegarlo en producción conviene evaluar aspectos como el soporte lingüístico y la privacidad de datos —la publicación original no detalla cobertura de idiomas ni políticas de entrenamiento específicas—, y realizar pruebas con datos reales de la organización para medir precisión y sesgos en escenarios locales.

Cómo acceder y próximos pasos

Los checkpoints en formatos BF16, FP8 y NVFP4 están disponibles en Hugging Face, lo que facilita que equipos de investigación y desarrolladores experimenten con el modelo. Para integraciones productivas será necesario considerar infraestructura compatible (GPU/NVIDIA) y la adaptación del modelo a flujos de datos propios.

Conclusión

Nemotron 3 Nano Omni representa un avance en modelos multimodales para tareas que requieren contexto largo y múltiples entradas (texto, imagen, audio, video). Sus mejoras en precisión y eficiencia, junto con soporte para agentic computer use, lo posicionan como una herramienta potente para casos empresariales complejos. Para América Latina, puede acelerar la automatización de procesos documentales y el análisis audiovisual, siempre que las organizaciones validen su rendimiento en datos locales y aseguren el cumplimiento de requisitos de privacidad y gobernanza.

Fuente original: Hugging Face Blog