Cómo los Transformers impulsan los LLMs: guía paso a paso

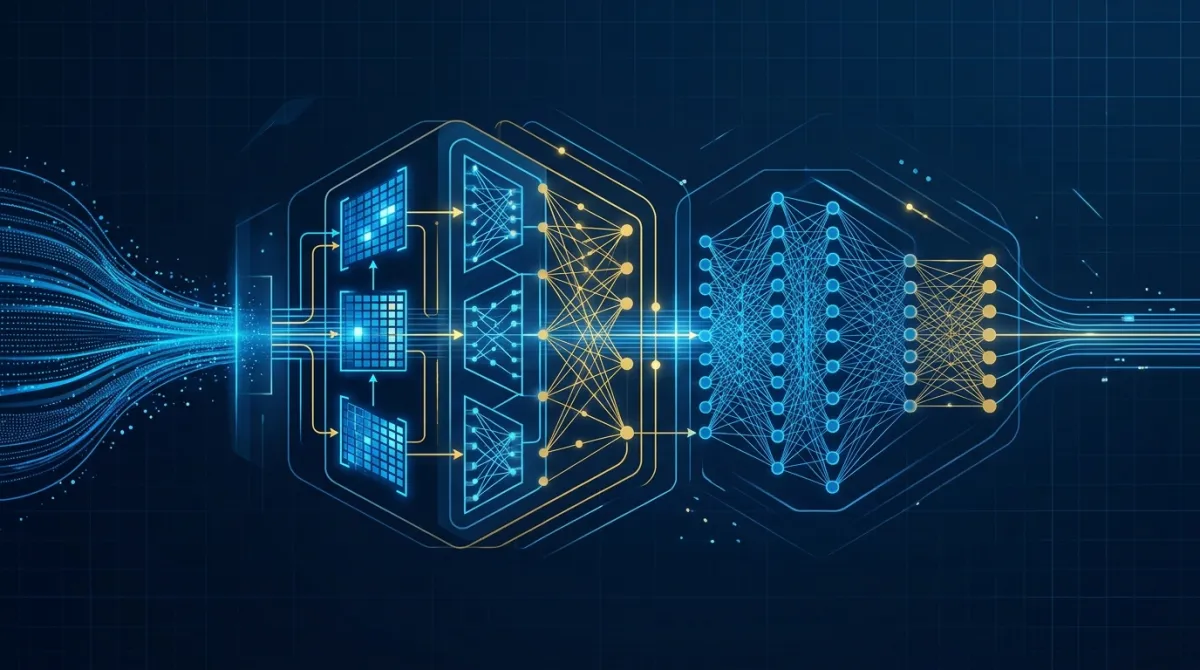

Los Transformers son la arquitectura que permitió el salto de los RNN/LSTM a los LLMs modernos. En este artículo desglosamos, paso a paso, desde la tokenización hasta la generación autoregresiva.

Introducción

Los Transformers transformaron (con perdón del juego de palabras) el procesamiento de lenguaje natural. A diferencia de enfoques previos basados en redes recurrentes (RNN) o LSTM, los Transformers pueden procesar todas las palabras de una secuencia en paralelo, lo que facilita entrenar modelos muy grandes y eficientes. Esa arquitectura es la base de LLMs conocidos como GPT, Claude y Gemini, que generan texto token a token a partir de grandes volúmenes de datos.

En este texto revisamos cómo funciona un Transformer en la práctica: cómo se convierte el texto en números, qué es la atención y cómo se arman los bloques que permiten a los modelos generar lenguaje coherente.

Parte 1: Cómo el texto se vuelve legible para la máquina

Paso 1: Tokenización — del texto a unidades manejables

Las redes neuronales trabajan con números, no con letras. La tokenización divide una cadena de texto en unidades (tokens) que luego reciben identificadores numéricos. Estas unidades pueden ser palabras completas, subpalabras o incluso caracteres y signos de puntuación.

Existen estrategias populares como Byte-Pair Encoding (BPE), WordPiece y Unigram. Todas comparten la idea de mantener como tokens las palabras frecuentes y dividir términos raros en piezas conocidas: por ejemplo, “transformers” puede ser un token único, mientras que una palabra poco común se fragmenta en prefijos, raíces y sufijos. La tokenización por subpalabras permite a los modelos manejar vocabulario nuevo o infrecuente usando componentes ya aprendidos.

Paso 2: Embeddings — convertir tokens en vectores

Cada token se transforma en un vector denso llamado embedding. Ese vector es una coordenada en un espacio de alta dimensión donde palabras con significados relacionados quedan cercanas entre sí: “hola” y “buenas” estarán más próximas que “hola” y “adiós”.

Los embeddings no son estáticos inventados a mano; se aprenden durante el entrenamiento del modelo a partir de grandes corpus. Cada token ID tiene asociado un vector numérico que alimenta las capas siguientes del Transformer.

Paso 3: Codificación posicional — enseñar el orden de las palabras

A diferencia de las RNN, que procesan secuencias en orden, los Transformers reciben todos los tokens a la vez. Por eso necesitan información explícita sobre la posición de cada token: las codificaciones posicionales añaden señales que permiten al modelo distinguir el orden de las palabras dentro de la oración. Sin esa información, el sistema no podría distinguir “el gato persigue al ratón” de “el ratón persigue al gato”.

Parte 2: La idea central que potenció los Transformers

Paso 4: Self-attention — cómo cada token mira el resto del contexto

La atención (attention) es el mecanismo que permite a cada token evaluar su relación con todos los otros tokens de la secuencia. En la práctica, cada token genera tres representaciones internas (conocidas como query, key y value) y compara su query con los keys de los demás para calcular qué tan relevante es cada token en el contexto actual. El resultado es una ponderación que combina los values y produce una representación contextualizada para cada posición.

Este proceso es lo que permite que un token entienda el contexto amplio y capture dependencias a largo plazo sin procesar la secuencia de forma estrictamente ordenada como ocurría en RNNs.

Paso 5: Multi-head attention — aprender múltiples relaciones simultáneamente

Una sola atención puede capturar un tipo de relación entre tokens; muchas aplicaciones requieren entender varios tipos de relaciones a la vez (por ejemplo, sintácticas y semánticas). La multi-head attention divide la representación en varias cabezas que realizan atenciones independientes y luego combinan sus salidas. Así, el modelo puede atender simultáneamente a diferentes aspectos del contexto y construir representaciones más ricas.

Parte 3: El bloque Transformer — el motor de los LLMs

Paso 6: Arquitectura del bloque decoder (cómo funciona el bloque típico)

En modelos generativos como GPT se utiliza una pila de bloques tipo “decoder”. Cada bloque suele incorporar: atención enmascarada (para que, durante la generación, un token sólo atienda a posiciones previas y no a futuras), multi-head attention y una red feed-forward que procesa la salida de la atención para capturar transformaciones no lineales.

Además, en la práctica se aplican normas y conexiones que estabilizan el entrenamiento y mejoran la convergencia, pero la idea central es que cada bloque toma representaciones contextuales y las refina capa tras capa.

Paso 7: Apilar capas — de bloques simples a modelos profundos

Para capturar patrones complejos del lenguaje, los Transformers se apilan: muchas capas similares se colocan una sobre otra. Cada capa agrega más capacidad de abstracción y permite al modelo aprender estructuras cada vez más complejas del lenguaje. Este apilamiento es lo que convierte a un conjunto de operaciones relativamente simples en un modelo capaz de realizar tareas avanzadas de comprensión y generación.

Parte 4: Cómo los LLMs generan texto en la práctica

Paso 8: Generación autoregresiva — un token a la vez

Modelos como GPT generan texto de forma autoregresiva: predicen el siguiente token basándose en los tokens previos, lo añaden a la secuencia y repiten el proceso. La atención enmascarada garantiza que, al predecir, el modelo no utilice información futura. De esta forma, la generación progresa paso a paso hasta formar oraciones completas.

Los equipos que desarrollan modelos —como los detrás de GPT, Claude o Gemini— aplican variaciones y optimizaciones a esta estructura básica para sus necesidades y datos específicos, pero la columna vertebral sigue siendo la misma: embeddings, atención y una pila de bloques Transformer.

Por qué los Transformers escalan tan bien

La capacidad para procesar tokens en paralelo permite aprovechar hardware moderno (GPUs, TPUs) de manera eficiente, acortando tiempos de entrenamiento frente a arquitecturas recurrentes. Además, la atención ofrece una forma directa de modelar relaciones a largo plazo sin depender de pasos secuenciales lentos. Esa combinación explica por qué los Transformers son la elección dominante para entrenar modelos de gran tamaño.

Conclusión

Los Transformers unificaron varios avances —tokenización inteligente, embeddings densos, codificación posicional y mecanismos de atención— en una arquitectura que hace posible entrenar LLMs capaces de generar texto coherente y contextual. Para equipos en América Latina, entender estos elementos ayuda a tomar decisiones sobre adaptación de modelos, curación de datos y despliegue en entornos productivos.

Preguntas frecuentes breves

- ¿Los Transformers reemplazan por completo a las RNN? Para la mayoría de tareas de gran escala en NLP, sí; su paralelismo y capacidad para capturar contexto largo los volvió preferidos.

- ¿Por qué son importantes las subpalabras en español? El uso de tokenización por subpalabras ayuda a manejar las variaciones morfológicas del español (conjugaciones, sufijos) y términos locales sin aumentar desproporcionadamente el vocabulario.

- ¿Todos los LLMs usan exactamente la misma arquitectura? No: muchos usan la misma idea base (atención y bloques apilados) pero modifican detalles para sus objetivos y restricciones.

Entender estos pasos les permitirá a responsables técnicos y de negocio evaluar mejor las opciones de modelo, datos y costos al adoptar LLMs en proyectos y productos en la región.

Fuente original: Analytics Vidhya